W nowoczesnych środowiskach rozwojowych definicja zakończenia uległa zmianie. Po prostu zakończenie zadania lub napisanie kodu nie jest już równoznaczne z dostarczeniem wartości. Zespoły coraz częściej odchodzą od liczenia linii kodu lub zaznaczania pól na tablicy backlogu w kierunku oceny rzeczywistego wpływu swojej pracy. Ten przewodnik bada kluczowy przesunięcie od wyjścia do wyniku, zapewniając ramy do mierzenia sukcesu poprzez zakończone wyniki historii użytkownika.

Sukces w dostarczaniu nie jest dwustanowym stanem zrobione lub niezrobione. Jest to spektrum realizacji wartości. Gdy historia zostaje oznaczona jako zakończona, prawdziwe pytanie brzmi: Czy ta zmiana poprawiła doświadczenie dla końcowego użytkownika? Czy rozwiązała podstawowy problem? Czy przesunęła wskaźnik biznesowy? Odpowiedź na te pytania wymaga świadomego podejścia do pomiaru, weryfikacji i feedbacku.

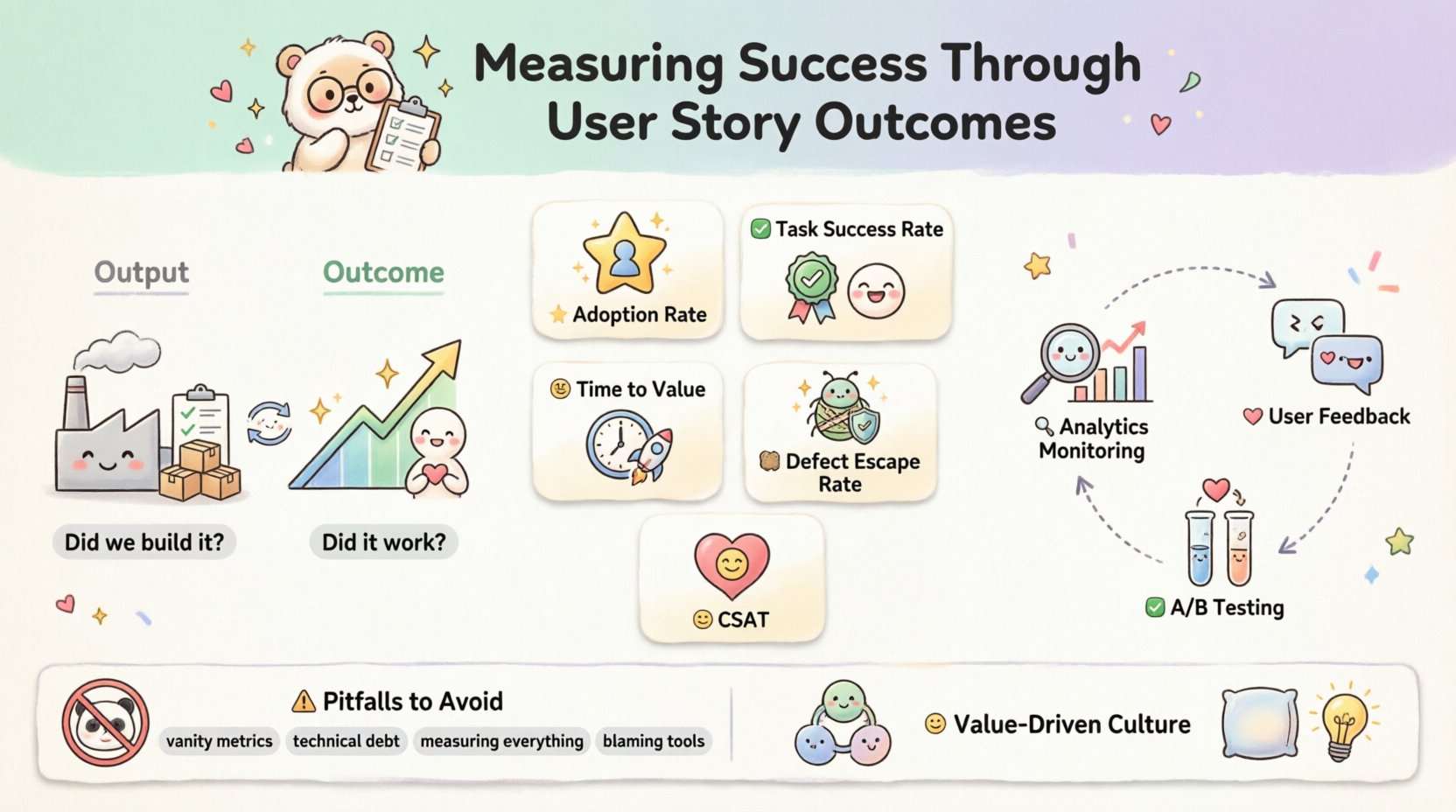

Rozumienie wyników historii użytkownika w porównaniu do wyjścia 🔄

Aby dokładnie zmierzyć sukces, należy najpierw rozróżnić to, co zostało wyprodukowane, i to, co zostało osiągnięte. Ta różnica stanowi fundament skutecznej selekcji metryk.

- Wyjście: Odnosi się do widocznych artefaktów stworzonych. Obejmuje liczbę zakończonych historii, liczbę wdrożonych funkcji lub prędkość zespołu. Odpowiada na pytanie: „Czy zbudowaliśmy to?”

- Wynik: Odnosi się do zmiany zachowania lub wartości dostarczonej klientowi. Obejmuje zwiększoną utrzymanie użytkowników, zmniejszoną liczbę zgłoszeń pomocy technicznej lub poprawione tempo ukończenia zadań. Odpowiada na pytanie: „Czy to działa?”

Opieranie się wyłącznie na metrykach wyjścia może prowadzić do syndromu „fabryki funkcji”, gdy zespoły są zajęte, ale stagnują. Metryki wyników wymuszają odpowiedzialność za wynik, a nie tylko za wysiłek. Ten przesunięcie wymaga przejrzystości i gotowości do przyjęcia, że zakończona historia może nie osiągnąć swoich zamierzonych celów, jeśli dane wynikowe nie odzwierciedlają sukcesu.

Kluczowe metryki do mierzenia sukcesu 📈

Wybór odpowiednich metryk jest kluczowy. Zbyt wiele metryk powoduje szum; zbyt mało ukrywa problemy. Poniższa tabela przedstawia istotne metryki do śledzenia podczas oceny wyników historii użytkownika.

| Metryka | Definicja | Dlaczego to ma znaczenie |

|---|---|---|

| Wskaźnik przyjęcia | Procent użytkowników, którzy korzystają z nowej funkcji po jej wydaniu. | Wskazuje, czy rozwiązanie naprawdę jest użyteczne dla docelowej grupy użytkowników. |

| Wskaźnik sukcesu zadania | Procent użytkowników, którzy ukończyli konkretne zadanie bez pomocy. | Mierzy użyteczność i jasność zaimplementowanej funkcjonalności. |

| Czas do wartości | Czas między wydaniem a momentem, w którym użytkownik czerpie korzyści z funkcji. | Wyróżnia efektywność dostarczania i trafność rozwiązania. |

| Wskaźnik ucieczki błędów | Liczba błędów zgłoszonych przez użytkowników po oznaczeniu historii jako zakończonej. | Odbija jakość pracy i skuteczność testowania. |

| Wskaźnik satysfakcji klientów (CSAT) | Bezpośrednie opinie użytkowników dotyczące ich doświadczenia z zmianą. | Dostarcza jakościową weryfikację wyniku. |

Podczas wdrażania tych metryk upewnij się, że są zgodne z konkretnym celem historii użytkownika. Historia skierowana na optymalizację wydajności nie powinna być mierzona za pomocą wskaźników przyjęcia, podczas gdy historia skierowana na zaangażowanie użytkownika nie powinna być mierzona wyłącznie pod kątem stabilności kodu.

Ustalanie jasnych kryteriów akceptacji ✅

Kryteria akceptacji to umowa między zespołem a stakeholderami. Definiują one warunki, przy których historia użytkownika jest uznawana za zakończoną. Jednak w kontekście pomiaru wyników te kryteria muszą wykraczać poza poprawność funkcjonalną.

- Wymagania funkcjonalne: System musi zachowywać się w określony sposób. (np. „Przycisk musi wysłać formularz.”)

- Wymagania niefunkcjonalne: System musi spełniać standardy wydajności lub bezpieczeństwa. (np. „Strona ładuje się w mniej niż 2 sekundy.”)

- Kryteria oparte na wynikach: System musi osiągnąć konkretny wynik. (np. „Użytkownicy powinni móc ukończyć proces zakupu bez porzucenia koszyka.”)

Pisanie kryteriów opartych na wynikach wymaga współpracy. Nie wystarczy stwierdzić, że funkcja została zbudowana; zespół musi określić, jak wygląda sukces w świecie rzeczywistym. Często oznacza to sformułowanie hipotezy. Na przykład: „Jeśli wdrożymy ten nowy menu nawigacji, użytkownicy będą znajdować produkty o 20% szybciej.”

Aby zweryfikować tę hipotezę, kryteria akceptacji muszą zawierać mechanizm pomiaru. Może to być określony event analizy danych do śledzenia lub pytanie ankiety do wdrożenia po dostępie do funkcji.

Weryfikacja po wdrożeniu 🔍

Po scaleniu i wdrożeniu historii, praca nie jest jeszcze zakończona. Weryfikacja to most między rozwojem a realizacją wartości. Ten etap obejmuje monitorowanie systemu i zbieranie danych potwierdzających hipotezę.

1. Monitorowanie analizy danych

Śledź zachowania zdefiniowane w kryteriach akceptacji. Jeśli celem było zmniejszenie liczby kliknięć, zweryfikuj ścieżkę kliknięć. Jeśli celem było zwiększenie konwersji, monitoruj funel. Dane powinny być dostępne od razu po wydaniu, aby wykryć regresje lub potwierdzić zyski.

2. Pętle zwrotne od użytkowników

Liczby mówią Ci, co się dzieje; użytkownicy mówią Ci dlaczego. Angażuj zespoły wsparcia, aby zebrać dane jakościowe. Szukaj wzorców w zgłoszeniach dotyczących nowej funkcji. Czy użytkownicy są zdezorientowani? Czy są zachwyceni? Bezpośrednie opinie są często bardziej przydatne niż surowe liczby.

3. Testy A/B

Gdy nie jesteś pewien najlepszego podejścia, testuj różne warianty. Wdrożenie funkcji dla małej grupy użytkowników pozwala na kontrolowany pomiar. Porównaj metryki wyników grupy kontrolnej z grupą testową. Pozwala to izolować wpływ konkretnej zmiany.

Powszechne pułapki w pomiarze ⚠️

Nawet z najlepszymi intencjami zespoły często popełniają błędy, próbując zmierzyć sukces. Znajomość tych powszechnych pułapek pomaga zachować integralność procesu.

- Pomiar wartości pozornej:Skupianie się na liczbach, które wyglądają dobrze, ale nie są skorelowane z wartością biznesową (np. całkowita liczba rejestracji bez analizy utrzymania). Unikaj metryk, które można manipulować bez rzeczywistego postępu.

- Ignorowanie długu technicznego:Optymalizacja pod kątem szybkości często prowadzi do problemów z jakością. Jeśli historia zostanie szybko zakończona, ale wymaga ciągłego utrzymania, długoterminowy wynik jest negatywny. Mierz stabilność kodu jako część sukcesu historii.

- Mierzenie wszystkiego:Śledzenie zbyt wielu wskaźników rozprasza uwagę. Wybierz jedną lub dwie kluczowe metryki wyników na historię. Jeśli metryka nie jest akcjonowalna, nie mierz jej.

- Przypisywanie winy narzędziu:Brak sukcesu nie zawsze jest problemem narzędziowym. Często jest to problem zakresu, zrozumienia lub dopasowania do rynku. Unikaj zakładania, że platforma jest przyczyną słabych wyników.

Integracja pętli zwrotnych 🔄

Pomiar jest bezużyteczny bez działania. Dane zebrane z zakończonych historii użytkownika muszą wrócić do procesu planowania. Tworzy to cykl ciągłego doskonalenia.

Analiza retrospektywna:W trakcie retrospektyw zespołu omawiaj dane wyników, a nie tylko proces. Czy historia osiągnęła swój cel? Jeśli nie, dlaczego? Czy cel był niewrealistyczny? Czy wdrożenie było błędne?

Doskonalenie listy backlogu:Używaj danych wyników do priorytetów przyszłej pracy. Jeśli podobna historia nie przyniosła wartości w przeszłości, rozważ ponownie podejście lub obniż jej priorytet. Jeśli pojawia się wzorzec sukcesu, zainwestuj bardziej w tę dziedzinę.

Komunikacja z zaangażowanymi stronami:Udostępnij wyniki wyników liderom biznesowym. Przejrzystość buduje zaufanie. Pokazując, że funkcja została dostarczona, ale nie spełniła oczekiwań, wykazujesz szczerość i zaangażowanie w wartość, a nie w pozory.

Wychowywanie kultury skupionej na wartości 🤝

Metryki i procesy to narzędzia, ale kultura to silnik. Zespół, który bał się porażki, nie będzie szczerze mierzył wyników. Manipulować będą danymi, by wydawały się sukcesem.

- Bezpieczeństwo psychologiczne:Utwórz środowisko, w którym przyznanie, że historia nie zadziałała, jest bezpieczne. Pozwala to na szczere analizy po zakończeniu i naukę.

- Wspólne odpowiedzialność:Każdy w zespole, od programistów po projektantów i właścicieli produktów, powinien dbać o wynik. Rozwój to nie tylko kod; to rozwiązywanie problemów.

- Nauka iteracyjna:Traktuj każdą historię jak eksperyment. Nawet jeśli wynik jest negatywny, zespół nauczył się czegoś wartościowego o użytkowniku lub systemie.

Ta zmiana kulturowa wymaga czasu. Wymaga ona spójnej wspierania ze strony liderów. Gdy skupienie pozostaje na rozwiązywaniu problemów, a nie na spełnianiu terminów, zespół naturalnie zmierza ku lepszym praktykom pomiaru.

Wnioski: Droga wartości 🚀

Mierzenie sukcesu poprzez zakończone wyniki historii użytkownika to nie jednorazowa konfiguracja. To ciągła dyscyplina wymagająca czujności i dostosowania. Przesuwając skupienie z wyjścia na wynik, zespoły mogą zapewnić, że ich praca naprawdę ma znaczenie.

Pamiętaj, że celem nie jest doskonałość, ale postęp. Każda zakończona historia to możliwość nauki. Używaj metryk do kierowania decyzjami, a nie do oceny wydajności. Gdy zespół skupia się na wartości, praca staje się bardziej znacząca, a wyniki bardziej istotne.

Zacznij od małego. Wybierz jedną historię. Zdefiniuj jasny wynik. Zmierz go. Naucz się. Powtarzaj. Ten podejście iteracyjne buduje solidny szkielet sukcesu, który rośnie wraz z organizacją.