En los entornos de desarrollo modernos, la definición de finalización ha cambiado. Simplemente terminar una tarea o escribir código ya no es sinónimo de entregar valor. Los equipos están avanzando cada vez más hacia dejar de contar líneas de código o marcar casillas en un tablero de pendientes, para centrarse en evaluar el impacto real de su trabajo. Esta guía explora el cambio fundamental de salida a resultado, proporcionando un marco para medir el éxito a través de los resultados de las historias de usuario completadas.

El éxito en la entrega no es un estado binario de hecho o no hecho. Es un espectro de realización de valor. Cuando una historia se marca como completa, la pregunta real es: ¿Esta cambio mejoró la experiencia del usuario final? ¿Resolvió el problema subyacente? ¿Movió la aguja del negocio? Responder a estas preguntas requiere un enfoque deliberado en la medición, la validación y los comentarios.

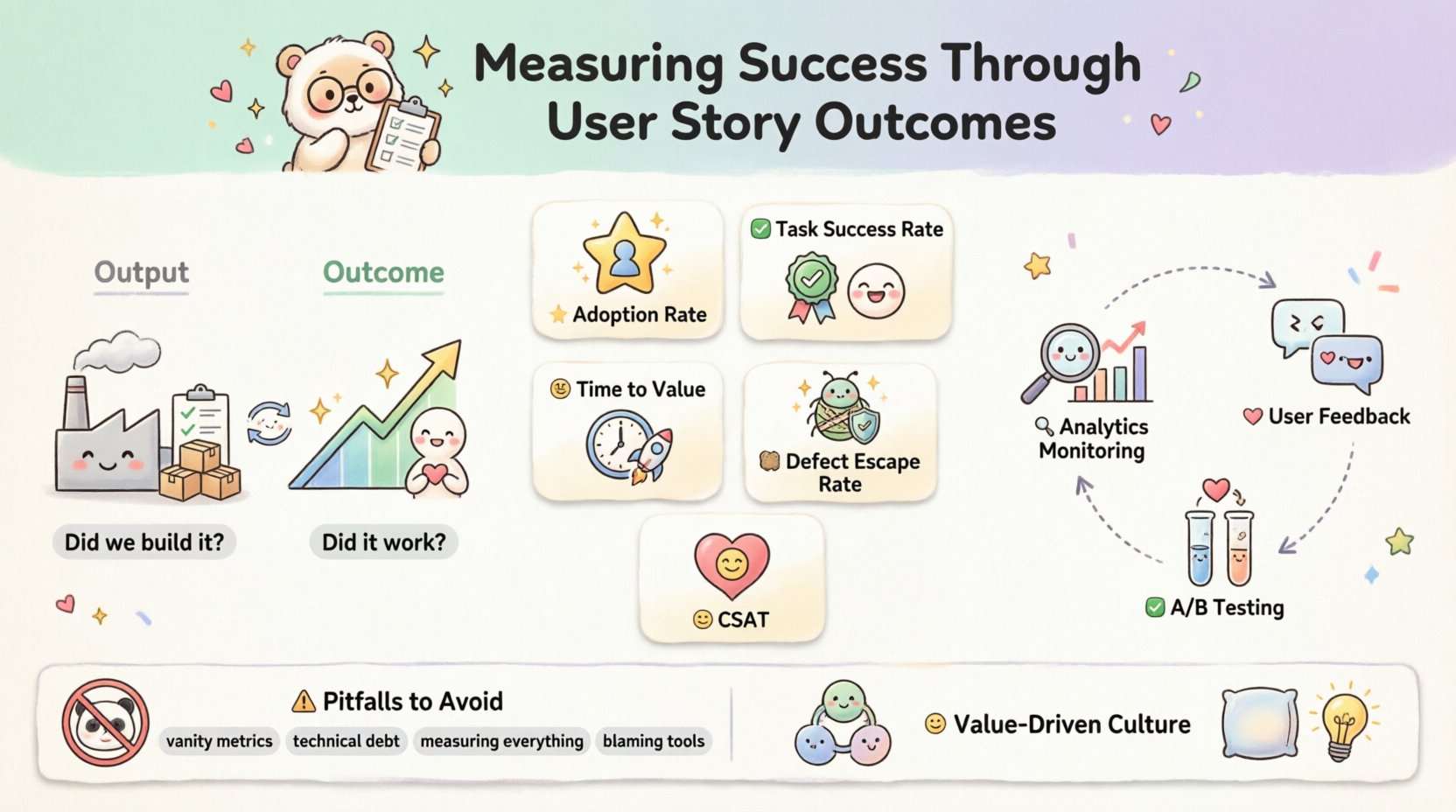

Comprender los resultados de las historias de usuario frente a la salida 🔄

Para medir el éxito con precisión, primero se debe distinguir entre lo que se produce y lo que se logra. Esta distinción forma la base de la selección efectiva de métricas.

- Salida: Se refiere a los artefactos tangibles creados. Incluye el número de historias completadas, el número de funciones lanzadas o la velocidad del equipo. Responde a la pregunta: ¿Lo construimos?

- Resultado: Se refiere al cambio en el comportamiento o al valor entregado al cliente. Incluye un aumento en la retención, una reducción en los tickets de soporte o una mejora en las tasas de finalización de tareas. Responde a la pregunta: ¿Funcionó?

Depender únicamente de métricas de salida puede conducir al síndrome de la “fábrica de funciones”, donde los equipos están ocupados pero estancados. Las métricas de resultado obligan a la responsabilidad del resultado, no solo del esfuerzo. Este cambio requiere transparencia y la disposición a aceptar que una historia completada podría no haber alcanzado su objetivo si los datos de resultado no reflejan el éxito.

Métricas clave para medir el éxito 📈

Seleccionar las métricas adecuadas es crucial. Demasiadas métricas generan ruido; demasiadas pocas ocultan problemas. La siguiente tabla enumera las métricas esenciales que se deben seguir al evaluar los resultados de las historias de usuario.

| Métrica | Definición | Por qué es importante |

|---|---|---|

| Tasa de adopción | El porcentaje de usuarios que interactúan con una nueva función después de su lanzamiento. | Indica si la solución es realmente útil para el público objetivo. |

| Tasa de éxito en tareas | El porcentaje de usuarios que completan una tarea específica sin ayuda. | Mide la usabilidad y claridad de la funcionalidad implementada. |

| Tiempo hasta el valor | La duración entre el lanzamiento y que el usuario obtenga beneficio de la función. | Destaca la eficiencia en la entrega y la relevancia de la solución. |

| Tasa de escape de defectos | El número de errores reportados por los usuarios después de que la historia se marque como completa. | Refleja la calidad del trabajo y la efectividad de las pruebas. |

| Puntuación de satisfacción del cliente (CSAT) | Comentarios directos de los usuarios sobre su experiencia con el cambio. | Proporciona una validación cualitativa del resultado. |

Al implementar estas métricas, asegúrese de que se alineen con la intención específica de la historia de usuario. Una historia orientada a la optimización del rendimiento no debe medirse mediante tasas de adopción, mientras que una historia orientada al compromiso del usuario no debe medirse únicamente por la estabilidad del código.

Establecer criterios de aceptación claros ✅

Los criterios de aceptación son el contrato entre el equipo y los interesados. Definen las condiciones bajo las cuales una historia de usuario se considera completa. Sin embargo, para la medición de resultados, estos criterios deben ir más allá de la corrección funcional.

- Requisitos funcionales: El sistema debe comportarse de una manera específica. (por ejemplo, “El botón debe enviar el formulario.”)

- Requisitos no funcionales: El sistema debe cumplir con estándares de rendimiento o seguridad. (por ejemplo, “La página se carga en menos de 2 segundos.”)

- Criterios basados en resultados: El sistema debe lograr un resultado específico. (por ejemplo, “Los usuarios deben poder completar el proceso de compra sin abandonar el carrito.”)

Redactar criterios basados en resultados requiere colaboración. No basta con decir que la funcionalidad está lista; el equipo debe definir qué significa el éxito en el mundo real. Esto a menudo implica formular una hipótesis. Por ejemplo, “Si implementamos este nuevo menú de navegación, los usuarios encontrarán productos un 20 % más rápido.”

Para validar esto, los criterios de aceptación deben incluir un mecanismo de medición. Esto podría ser un evento específico de análisis para rastrear o una pregunta de encuesta para desplegar al acceder a la funcionalidad.

Validación posterior a la implementación 🔍

Una vez que una historia se fusiona y se despliega, el trabajo no ha terminado. La validación es el puente entre el desarrollo y la realización de valor. Esta fase implica monitorear el sistema y recopilar datos para confirmar la hipótesis.

1. Monitoreo de análisis

Monitorea los comportamientos definidos en tus criterios de aceptación. Si el objetivo era reducir clics, verifica la ruta de clics. Si el objetivo era aumentar la conversión, monitorea el embudo. Los datos deben estar disponibles inmediatamente después del lanzamiento para detectar regresiones o confirmar mejoras.

2. Bucles de retroalimentación del usuario

Los números te dicen qué está sucediendo; los usuarios te dicen por qué. Interactúa con los equipos de soporte para recopilar datos cualitativos. Busca patrones en los tickets relacionados con la nueva funcionalidad. ¿Los usuarios están confundidos? ¿Están encantados? La retroalimentación directa suele ser más útil que los números crudos.

3. Pruebas A/B

Cuando no estés seguro sobre el mejor enfoque, prueba variaciones. Desplegar una funcionalidad a un pequeño grupo de usuarios permite una medición controlada. Compara las métricas de resultados del grupo de control con las del grupo de tratamiento. Esto aísla el impacto del cambio específico.

Errores comunes en la medición ⚠️

Incluso con las mejores intenciones, los equipos a menudo tropiezan al intentar medir el éxito. Ser consciente de estas trampas comunes ayuda a mantener la integridad en el proceso.

- Métricas de vanidad:Enfocarse en números que parecen buenos pero no se correlacionan con el valor para el negocio (por ejemplo, registros totales sin análisis de retención). Evita métricas que puedan manipularse sin generar progreso real.

- Ignorar la deuda técnica:Optimizar por velocidad a menudo conduce a problemas de calidad. Si una historia se completa rápidamente pero requiere mantenimiento constante, el resultado a largo plazo es negativo. Mide la estabilidad del código como parte del éxito de la historia.

- Medir todo:Seguir demasiados indicadores diluye el enfoque. Elige una o dos métricas clave de resultados por historia. Si una métrica no es accionable, no la midas.

- Culpar a la herramienta:La falta de éxito no siempre es un problema de herramientas. A menudo es un problema de alcance, comprensión o ajuste al mercado. Evita asumir que la plataforma es la causa raíz de resultados pobres.

Integrar bucles de retroalimentación 🔄

La medición es inútil sin acción. Los datos recopilados de las historias de usuario completadas deben alimentar de nuevo el proceso de planificación. Esto crea un ciclo de mejora continua.

Análisis retrospectivo:Durante las retrospectivas del equipo, discutan los datos de resultados, no solo el proceso. ¿Cumplió la historia su objetivo? Si no, ¿por qué? ¿El objetivo era irrealisable? ¿Hubo fallas en la implementación?

Perfeccionamiento del backlog:Utilice los datos de resultados para priorizar el trabajo futuro. Si una historia similar no logró generar valor en el pasado, vuelva a considerar el enfoque o depriorícela. Si surge un patrón de éxito, invierta con mayor intensidad en esa área.

Comunicación con partes interesadas:Comparta los resultados de los resultados con los líderes empresariales. La transparencia genera confianza. Mostrar que una característica fue entregada pero no cumplió con las expectativas demuestra honestidad y un compromiso con el valor, no con lo superficial.

Fomentar una cultura centrada en el valor 🤝

Las métricas y los procesos son herramientas, pero la cultura es el motor. Un equipo que teme el fracaso no medirá los resultados con honestidad. Manipularán los datos para que parezca que hubo éxito.

- Seguridad psicológica:Cree un entorno en el que admitir que una historia no funcionó sea seguro. Esto permite análisis honestos y aprendizaje.

- Propiedad compartida:Todos en el equipo, desde desarrolladores hasta diseñadores y propietarios de producto, deben preocuparse por el resultado. El desarrollo no se trata solo de código; se trata de resolver problemas.

- Aprendizaje iterativo:Trate cada historia como un experimento. Incluso si el resultado es negativo, el equipo ha aprendido algo valioso sobre el usuario o el sistema.

Este cambio cultural lleva tiempo. Requiere un refuerzo constante por parte de la dirección. Cuando el enfoque permanece en resolver problemas en lugar de cumplir fechas límite, el equipo se orienta naturalmente hacia mejores prácticas de medición.

Conclusión: El viaje del valor 🚀

Medir el éxito a través de los resultados de historias de usuario completadas no es una configuración única. Es una disciplina continua que requiere vigilancia y adaptación. Al cambiar el enfoque de la salida hacia el resultado, los equipos pueden asegurarse de que su trabajo realmente importe.

Recuerde que el objetivo no es la perfección, sino el progreso. Cada historia completada ofrece una oportunidad para aprender. Utilice las métricas para guiar decisiones, no para juzgar el desempeño. Cuando el equipo se alinea en torno al valor, el trabajo se vuelve más significativo y los resultados más impactantes.

Empiece pequeño. Elija una historia. Defina un resultado claro. Médialo. Aprenda. Repita. Este enfoque iterativo construye un marco sólido para el éxito que crece con la organización.