In modernen Entwicklungs-Umgebungen hat sich die Definition von Abschluss verschoben. Einfach eine Aufgabe zu erledigen oder Code zu schreiben, ist nicht mehr gleichbedeutend mit Wertlieferung. Teams bewegen sich zunehmend weg von der Zählung von Codezeilen oder dem Abhaken von Feldern auf einer Backlog-Tafel hin zur Bewertung des tatsächlichen Einflusses ihrer Arbeit. Dieser Leitfaden untersucht die entscheidende Verschiebung von Output zu Outcome und bietet einen Rahmen, um Erfolg durch abgeschlossene Nutzergeschichten-Ergebnisse zu messen.

Erfolg bei der Lieferung ist kein binärer Zustand von erledigt oder nicht erledigt. Es ist ein Spektrum der Wertrealisierung. Wenn eine Geschichte als abgeschlossen markiert wird, stellt sich die eigentliche Frage: Hat diese Änderung die Erfahrung des Endnutzers verbessert? Hat sie das zugrundeliegende Problem gelöst? Hat sie die Geschäftskennzahlen beeinflusst? Die Beantwortung dieser Fragen erfordert einen bewussten Ansatz zur Messung, Validierung und Rückmeldung.

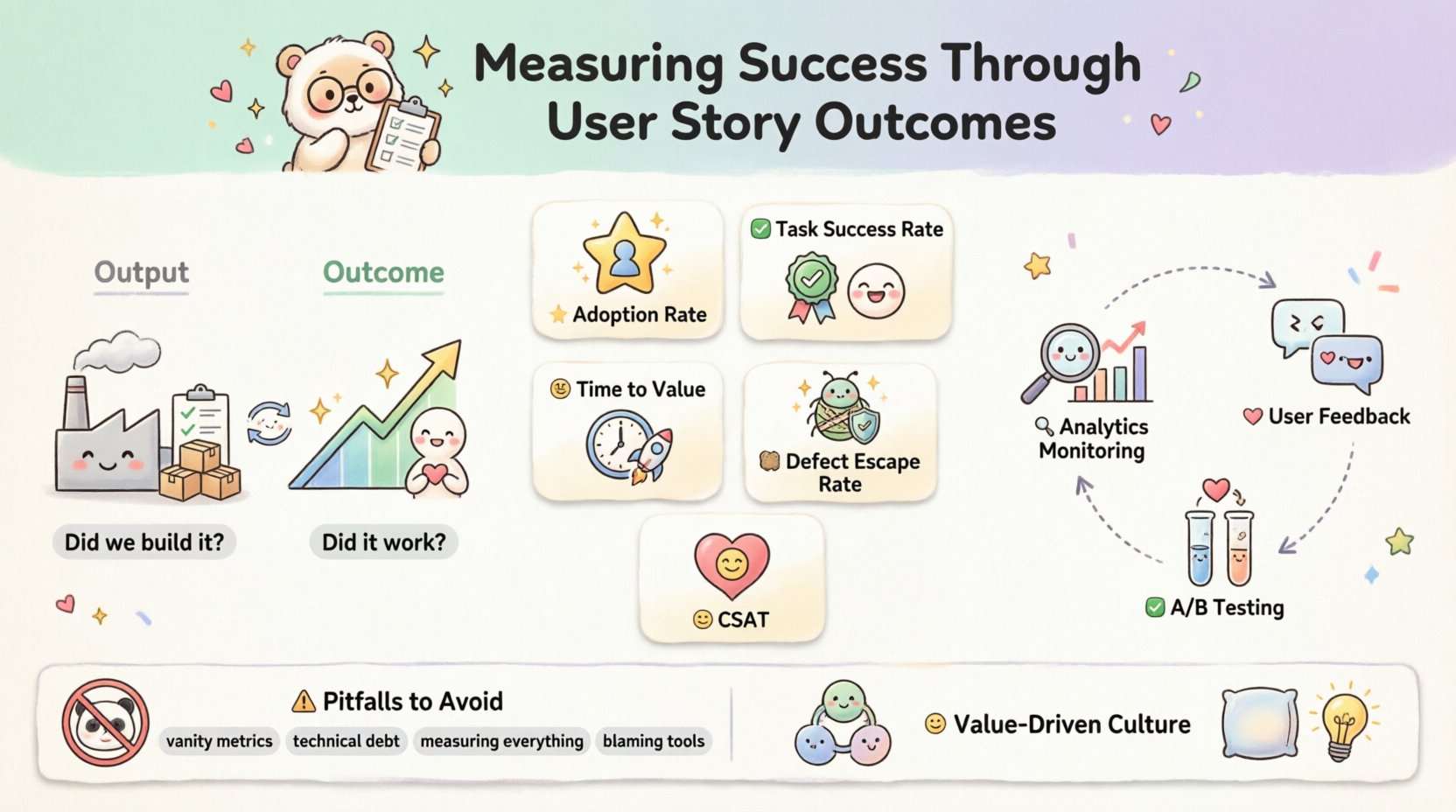

Verständnis von Nutzer-Geschichten-Ergebnissen im Vergleich zu Output 🔄

Um Erfolg genau zu messen, muss man zuerst zwischen dem Erzeugten und dem Erreichten unterscheiden. Diese Unterscheidung bildet die Grundlage für die Auswahl wirksamer Metriken.

- Output: Dies bezieht sich auf die greifbaren Artefakte, die erstellt wurden. Dazu gehören die Anzahl abgeschlossener Geschichten, die Anzahl der freigegebenen Funktionen oder die Geschwindigkeit des Teams. Es beantwortet die Frage: „Haben wir es gebaut?“

- Ergebnis: Dies bezieht sich auf die Veränderung im Verhalten oder den Wert, den der Kunde erhält. Dazu gehören erhöhte Kundenbindung, reduzierte Support-Tickets oder verbesserte Aufgabenabwicklungsraten. Es beantwortet die Frage: „Hat es funktioniert?“

Die alleinige Abhängigkeit von Output-Metriken kann zum „Feature-Fabrik“-Syndrom führen, bei dem Teams beschäftigt, aber stagnierend sind. Outcome-Metriken zwingen zur Verantwortung für das Ergebnis, nicht nur für die Anstrengung. Diese Verschiebung erfordert Transparenz und die Bereitschaft anzuerkennen, dass eine abgeschlossene Geschichte ihr vorgesehenes Ziel möglicherweise nicht erreicht hat, wenn die Ergebnisdaten keinen Erfolg widerspiegeln.

Wichtige Metriken zur Messung des Erfolgs 📈

Die Auswahl der richtigen Metriken ist entscheidend. Zu viele Metriken erzeugen Rauschen; zu wenige verbergen Probleme. Die folgende Tabelle zeigt wesentliche Metriken auf, die verfolgt werden sollten, wenn Nutzer-Geschichten-Ergebnisse bewertet werden.

| Metrik | Definition | Warum es wichtig ist |

|---|---|---|

| Adoption-Rate | Der Prozentsatz der Nutzer, die sich nach der Freigabe mit einer neuen Funktion beschäftigen. | Zeigt an, ob die Lösung tatsächlich für die Zielgruppe nützlich ist. |

| Aufgaben-Erfolgsrate | Der Prozentsatz der Nutzer, die eine bestimmte Aufgabe ohne Unterstützung abschließen. | Misst die Benutzerfreundlichkeit und Klarheit der implementierten Funktionalität. |

| Zeit bis zum Nutzen | Die Dauer zwischen der Freigabe und dem Zeitpunkt, zu dem der Nutzer Vorteile aus der Funktion zieht. | Hebt die Effizienz der Lieferung und die Relevanz der Lösung hervor. |

| Fehler-Entkapselungsrate | Die Anzahl der Fehler, die Nutzer melden, nachdem die Geschichte als abgeschlossen markiert wurde. | Spiegelt die Qualität der Arbeit und die Wirksamkeit des Testens wider. |

| Kundenzufriedenheits-Score (CSAT) | Direkte Rückmeldungen der Nutzer bezüglich ihrer Erfahrung mit der Änderung. | Bietet qualitative Validierung des Ergebnisses. |

Bei der Implementierung dieser Metriken stellen Sie sicher, dass sie mit dem spezifischen Ziel der User Story übereinstimmen. Eine Story, die auf die Leistungsoptimierung abzielt, sollte nicht anhand der Akzeptanzraten gemessen werden, während eine Story, die auf die Benutzerengagement abzielt, nicht ausschließlich anhand der Code-Stabilität gemessen werden sollte.

Klare Akzeptanzkriterien festlegen ✅

Akzeptanzkriterien sind der Vertrag zwischen dem Team und den Stakeholdern. Sie definieren die Bedingungen, unter denen eine User Story als abgeschlossen gilt. Für die Messung des Ergebnisses müssen diese Kriterien jedoch über die funktionale Korrektheit hinausgehen.

- Funktionale Anforderungen: Das System muss sich auf eine bestimmte Weise verhalten. (z. B. „Der Button muss das Formular absenden.“)

- Nicht-funktionale Anforderungen: Das System muss Leistungs- oder Sicherheitsstandards erfüllen. (z. B. „Die Seite lädt in weniger als 2 Sekunden.“)

- Ergebnisbasierte Kriterien: Das System muss ein bestimmtes Ergebnis erzielen. (z. B. „Benutzer sollten den Checkout-Prozess abschließen können, ohne den Warenkorb zu verlassen.“)

Das Schreiben ergebnisbasierter Kriterien erfordert Zusammenarbeit. Es reicht nicht aus, zu sagen, dass die Funktion gebaut ist; das Team muss definieren, wie Erfolg in der realen Welt aussehen soll. Dies erfordert oft die Formulierung einer Hypothese. Zum Beispiel: „Wenn wir dieses neue Navigationsmenü implementieren, finden Benutzer Produkte 20 % schneller.“

Um diese Hypothese zu validieren, müssen die Akzeptanzkriterien eine Messmechanismus enthalten. Dies könnte ein spezifisches Analytics-Ereignis zur Verfolgung oder eine Umfragefragen sein, die bei Zugriff auf die Funktion bereitgestellt wird.

Validierung nach der Implementierung 🔍

Sobald eine Story zusammengeführt und bereitgestellt wurde, ist die Arbeit noch nicht abgeschlossen. Die Validierung ist die Brücke zwischen Entwicklung und Wertrealisierung. In dieser Phase wird das System überwacht und Daten gesammelt, um die Hypothese zu bestätigen.

1. Analyseüberwachung

Verfolgen Sie das Verhalten, das in Ihren Akzeptanzkriterien definiert ist. Wenn das Ziel darin bestand, Klicks zu reduzieren, überprüfen Sie den Klickpfad. Wenn das Ziel darin bestand, die Konversion zu erhöhen, überwachen Sie den Verkaufsfunnel. Die Daten sollten unmittelbar nach der Veröffentlichung verfügbar sein, um Regressionen zu erkennen oder Erfolge zu bestätigen.

2. Benutzerfeedbackschleifen

Zahlen sagen Ihnen, was geschieht; Benutzer sagen Ihnen, warum. Engagieren Sie sich mit Support-Teams, um qualitative Daten zu sammeln. Suchen Sie nach Mustern in Tickets, die mit der neuen Funktion verbunden sind. Sind Benutzer verwirrt? Sind sie begeistert? Direktes Feedback ist oft aussagekräftiger als rohe Zahlen.

3. A/B-Tests

Wenn Sie unsicher sind, welcher Ansatz am besten ist, testen Sie Variationen. Die Bereitstellung einer Funktion für eine kleine Nutzergruppe ermöglicht eine kontrollierte Messung. Vergleichen Sie die Ergebnismetriken der Kontrollgruppe mit denen der Testgruppe. Dadurch wird der Einfluss der spezifischen Änderung isoliert.

Häufige Fehler bei der Messung ⚠️

Selbst mit den besten Absichten stolpern Teams oft, wenn sie den Erfolg messen wollen. Die Kenntnis dieser häufigen Fallen hilft, die Integrität des Prozesses zu wahren.

- Schönheitsmetriken:Die Aufmerksamkeit auf Zahlen zu richten, die gut aussehen, aber keine Korrelation zum Geschäftswert haben (z. B. Gesamtanzahl der Anmeldungen ohne Retentionsanalyse). Vermeiden Sie Metriken, die manipuliert werden können, ohne echten Fortschritt zu liefern.

- Technische Schulden ignorieren:Die Optimierung für Geschwindigkeit führt oft zu Qualitätsproblemen. Wenn eine Story schnell abgeschlossen wird, aber ständige Wartung erfordert, ist das langfristige Ergebnis negativ. Messen Sie die Stabilität des Codes als Teil des Erfolgs der Story.

- Alles messen:Die Verfolgung zu vieler Indikatoren verliert die Fokussierung. Wählen Sie pro Story ein oder zwei Schlüsselergebnismetriken aus. Wenn eine Metrik nicht handlungsleitend ist, messen Sie sie nicht.

- Die Schuld am Werkzeug suchen:Ein Mangel an Erfolg ist nicht immer ein Werkzeugproblem. Oft handelt es sich um ein Problem der Abdeckung, des Verständnisses oder der Marktpassung. Vermeiden Sie die Annahme, dass die Plattform die Ursache für schlechte Ergebnisse ist.

Feedbackschleifen integrieren 🔄

Die Messung ist nutzlos ohne Handlung. Die Daten, die aus abgeschlossenen User Stories gewonnen wurden, müssen in den Planungsprozess zurückfließen. Dadurch entsteht ein Zyklus der kontinuierlichen Verbesserung.

Rückblickende Analyse:Während der Team-Retrospektiven besprecht man die Ergebnisdaten, nicht nur den Prozess. Hat die Geschichte ihr Ziel erreicht? Wenn nicht, warum? War das Ziel unrealistisch? War die Umsetzung fehlerhaft?

Backlog-Optimierung:Verwende Ergebnisdaten, um zukünftige Arbeit zu priorisieren. Wenn eine ähnliche Geschichte in der Vergangenheit keinen Wert geliefert hat, überdenke die Herangehensweise oder setze sie zurück. Wenn sich ein Muster des Erfolgs abzeichnet, investiere stärker in diesen Bereich.

Kommunikation mit Stakeholdern:Teile die Ergebnisdaten mit Geschäftsführern. Transparenz schafft Vertrauen. Dass ein Feature geliefert wurde, aber die Erwartungen nicht erfüllt hat, zeigt Ehrlichkeit und ein Engagement für Wert statt bloßer Eitelkeit.

Aufbau einer wertorientierten Kultur 🤝

Metriken und Prozesse sind Werkzeuge, aber die Kultur ist der Motor. Ein Team, das Angst vor Misserfolg hat, wird Ergebnisse nicht ehrlich messen. Es wird Daten manipulieren, um den Anschein von Erfolg zu erwecken.

- Psychologische Sicherheit:Schaffe eine Umgebung, in der es sicher ist, zuzugeben, dass eine Geschichte nicht funktioniert hat. Dadurch können ehrliche Nachbesprechungen und Lernprozesse stattfinden.

- Geteilte Verantwortung:Jeder im Team, von Entwicklern über Designer bis hin zu Product Owners, sollte sich für das Ergebnis interessieren. Entwicklung geht nicht nur um Code; es geht darum, Probleme zu lösen.

- Iteratives Lernen:Behandle jede Geschichte wie ein Experiment. Selbst wenn das Ergebnis negativ ist, hat das Team etwas Wertvolles über den Nutzer oder das System gelernt.

Diese kulturelle Veränderung braucht Zeit. Sie erfordert konsequente Unterstützung durch die Führung. Wenn der Fokus auf der Lösung von Problemen statt auf dem Treffen von Deadlines liegt, neigt das Team von selbst zu besseren Messpraktiken.

Schlussfolgerung: Die Reise des Werts 🚀

Erfolg durch abgeschlossene Nutzerstory-Ergebnisse zu messen, ist kein einmaliger Aufbau. Es ist eine kontinuierliche Disziplin, die Aufmerksamkeit und Anpassung erfordert. Indem man den Fokus von Output auf Outcome verlegt, können Teams sicherstellen, dass ihre Arbeit wirklich zählt.

Denke daran, dass das Ziel keine Perfektion, sondern Fortschritt ist. Jede abgeschlossene Geschichte bietet eine Gelegenheit zum Lernen. Nutze die Metriken, um Entscheidungen zu leiten, nicht, um Leistungen zu bewerten. Wenn das Team sich auf Wert ausrichtet, wird die Arbeit bedeutungsvoller und die Ergebnisse wirksamer.

Fang klein an. Wähle eine Geschichte aus. Definiere ein klares Ergebnis. Messt es. Lern. Wiederhole. Dieser iterative Ansatz baut ein robustes Fundament für Erfolg, das sich mit der Organisation entwickelt.