Em ambientes de desenvolvimento modernos, a definição de conclusão mudou. Simplesmente finalizar uma tarefa ou escrever código já não é sinônimo de entregar valor. As equipes estão cada vez mais se afastando da contagem de linhas de código ou da marcação de caixas em um quadro de backlog em direção à avaliação do impacto real do seu trabalho. Este guia explora a mudança fundamental de saída para resultado, fornecendo uma estrutura para medir o sucesso por meio de resultados de histórias de usuário concluídas.

O sucesso na entrega não é um estado binário de feito ou não feito. É um espectro de realização de valor. Quando uma história é marcada como concluída, a pergunta real torna-se: essa mudança melhorou a experiência do usuário final? Resolveu o problema subjacente? Moveu a agulha do negócio? Responder a essas perguntas exige uma abordagem deliberada de medição, validação e feedback.

Compreendendo Resultados de Histórias de Usuário em Contração com Saída 🔄

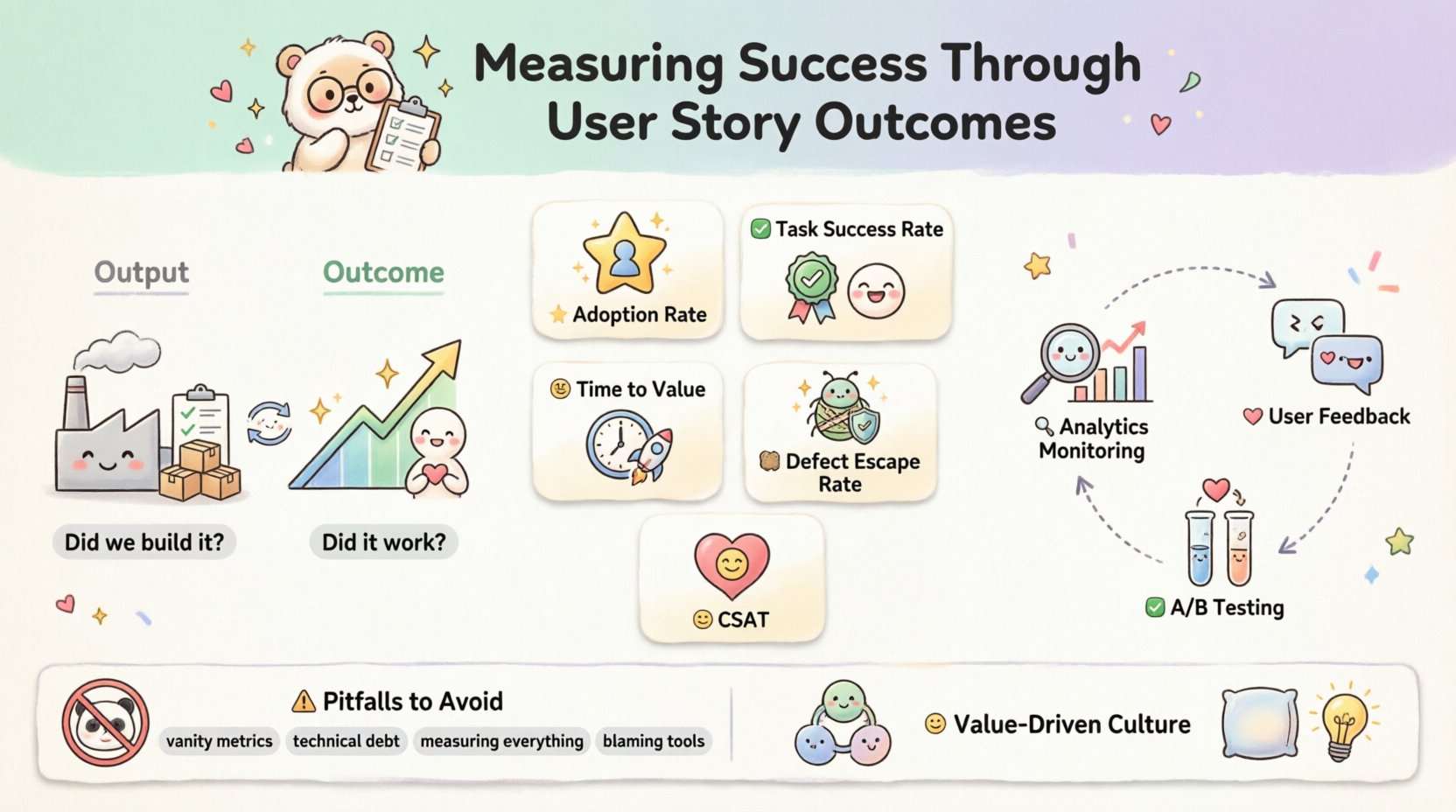

Para medir com precisão o sucesso, é necessário primeiro distinguir entre o que é produzido e o que é alcançado. Essa distinção forma a base da seleção eficaz de métricas.

- Saída: Isso se refere aos artefatos tangíveis criados. Inclui o número de histórias concluídas, o número de funcionalidades lançadas ou a velocidade da equipe. Responde à pergunta: ‘Nós construímos isso?’

- Resultado: Isso se refere à mudança no comportamento ou ao valor entregue ao cliente. Inclui aumento na retenção, redução nos tickets de suporte ou melhoria nas taxas de conclusão de tarefas. Responde à pergunta: ‘Funcionou?’

Depender exclusivamente de métricas de saída pode levar ao sintoma da ‘fábrica de funcionalidades’, onde as equipes estão ocupadas, mas estagnadas. As métricas de resultado exigem responsabilidade pelo resultado, e não apenas pelo esforço. Esse deslocamento exige transparência e disposição para aceitar que uma história concluída pode não ter alcançado seu objetivo pretendido se os dados de resultado não refletirem o sucesso.

Métricas-Chave para Medir o Sucesso 📈

Selecionar as métricas certas é crucial. Muitas métricas geram ruído; poucas escondem problemas. A tabela a seguir apresenta as métricas essenciais para acompanhar ao avaliar os resultados de histórias de usuário.

| Métrica | Definição | Por que isso importa |

|---|---|---|

| Taxa de Adoção | A porcentagem de usuários que interagem com uma nova funcionalidade após o lançamento. | Indica se a solução é realmente útil para o público-alvo. |

| Taxa de Sucesso na Tarefa | A porcentagem de usuários que concluem uma tarefa específica sem ajuda. | Mede a usabilidade e a clareza da funcionalidade implementada. |

| Tempo até o Valor | O período entre o lançamento e o usuário obter benefício com a funcionalidade. | Destaca a eficiência na entrega e a relevância da solução. |

| Taxa de Fuga de Defeitos | O número de bugs relatados pelos usuários após a história ser marcada como concluída. | Reflete a qualidade do trabalho e a eficácia dos testes. |

| Índice de Satisfação do Cliente (CSAT) | Feedback direto dos usuários sobre sua experiência com a mudança. | Fornece validação qualitativa do resultado. |

Ao implementar estas métricas, certifique-se de que elas estejam alinhadas com a intenção específica da história do usuário. Uma história voltada para a otimização de desempenho não deve ser medida pela taxa de adoção, enquanto uma história voltada para o engajamento do usuário não deve ser medida exclusivamente pela estabilidade do código.

Definindo Critérios de Aceitação Claros ✅

Os critérios de aceitação são o contrato entre a equipe e os interessados. Eles definem as condições sob as quais uma história do usuário é considerada concluída. No entanto, para a medição de resultados, esses critérios devem ir além da correção funcional.

- Requisitos Funcionais: O sistema deve se comportar de uma maneira específica. (por exemplo, “O botão deve enviar o formulário.”)

- Requisitos Não Funcionais: O sistema deve atender a padrões de desempenho ou segurança. (por exemplo, “A página carrega em menos de 2 segundos.”)

- Critérios Baseados em Resultados: O sistema deve alcançar um resultado específico. (por exemplo, “Os usuários devem ser capazes de concluir o processo de checkout sem abandonar o carrinho.”)

Escrever critérios baseados em resultados exige colaboração. Não basta dizer que o recurso foi construído; a equipe deve definir como o sucesso se parece no mundo real. Isso frequentemente envolve a definição de uma hipótese. Por exemplo, “Se implementarmos este novo menu de navegação, os usuários encontrarão produtos 20% mais rápido.”

Para validar isso, os critérios de aceitação devem incluir um mecanismo de medição. Isso pode ser um evento específico de análise para rastrear ou uma pergunta de pesquisa para implantar ao acesso do recurso.

Validação Pós-Implementação 🔍

Uma vez que uma história é mesclada e implantada, o trabalho não está terminado. A validação é a ponte entre o desenvolvimento e a realização de valor. Esta fase envolve o monitoramento do sistema e a coleta de dados para confirmar a hipótese.

1. Monitoramento de Analytics

Monitore os comportamentos definidos nos seus critérios de aceitação. Se o objetivo era reduzir cliques, verifique o caminho de cliques. Se o objetivo era aumentar a conversão, monitore o funil. Os dados devem estar disponíveis imediatamente após o lançamento para detectar regressões ou confirmar ganhos.

2. Ciclos de Feedback do Usuário

Números dizem o que está acontecendo; os usuários dizem por quê. Envolve-se com equipes de suporte para coletar dados qualitativos. Procure padrões em chamados relacionados ao novo recurso. Os usuários estão confusos? Estão encantados? O feedback direto é frequentemente mais acionável do que números brutos.

3. Testes A/B

Quando houver incerteza sobre a melhor abordagem, teste variações. Implantar um recurso em um pequeno grupo de usuários permite uma medição controlada. Compare as métricas de resultado do grupo controle com o grupo de tratamento. Isso isola o impacto da mudança específica.

Armadilhas Comuns na Medição ⚠️

Mesmo com as melhores intenções, as equipes frequentemente tropeçam ao tentar medir o sucesso. Estar ciente dessas armadilhas comuns ajuda a manter a integridade no processo.

- Métricas Vaidosas:Focar em números que parecem bons, mas não se correlacionam com valor para o negócio (por exemplo, total de inscrições sem análise de retenção). Evite métricas que podem ser manipuladas sem gerar progresso real.

- Ignorar a Dívida Técnica:Otimizar pela velocidade frequentemente leva a problemas de qualidade. Se uma história for concluída rapidamente, mas exigir manutenção constante, o resultado de longo prazo será negativo. Meça a estabilidade do código como parte do sucesso da história.

- Medir Tudo:Rastrear muitos indicadores dilui o foco. Escolha uma ou duas métricas-chave de resultado por história. Se uma métrica não for acionável, não a meça.

- Culpar a Ferramenta:A falta de sucesso nem sempre é um problema de ferramentas. Muitas vezes é um problema de escopo, entendimento ou adequação ao mercado. Evite assumir que a plataforma é a causa raiz de resultados ruins.

Integrando Ciclos de Feedback 🔄

Medição é inútil sem ação. Os dados coletados a partir das histórias de usuário concluídas devem alimentar de volta o processo de planejamento. Isso cria um ciclo de melhoria contínua.

Análise Retrospectiva:Durante as retrospectivas da equipe, discuta os dados de resultado, e não apenas o processo. A história atingiu seu objetivo? Se não, por quê? O objetivo era irreais? A implementação foi deficiente?

Aprimoramento da Lista de Pendências:Use os dados de resultado para priorizar o trabalho futuro. Se uma história semelhante falhou em gerar valor no passado, reavalie a abordagem ou dê menor prioridade a ela. Se surgir um padrão de sucesso, invista mais pesadamente nessa área.

Comunicação com Stakeholders:Compartilhe os resultados de resultado com os líderes empresariais. A transparência constrói confiança. Mostrar que um recurso foi entregue, mas não atendeu às expectativas, demonstra honestidade e compromisso com o valor, e não com a aparência.

Cultivando uma Cultura Orientada para o Valor 🤝

Métricas e processos são ferramentas, mas a cultura é o motor. Uma equipe com medo de falhar não medirá os resultados com honestidade. Ela manipulará os dados para parecer sucesso.

- Segurança Psicológica:Crie um ambiente em que admitir que uma história não funcionou seja seguro. Isso permite pós-análises honestas e aprendizado.

- Propriedade Compartilhada:Todos na equipe, desde desenvolvedores até designers e proprietários de produtos, deveriam se importar com o resultado. O desenvolvimento não é apenas sobre código; é sobre resolver problemas.

- Aprendizado Iterativo:Trate cada história como um experimento. Mesmo que o resultado seja negativo, a equipe aprendeu algo valioso sobre o usuário ou o sistema.

Essa mudança cultural leva tempo. Exige reforço constante da liderança. Quando a atenção permanece na resolução de problemas e não no cumprimento de prazos, a equipe naturalmente se inclina para práticas de medição melhores.

Conclusão: A Jornada do Valor 🚀

Medir o sucesso por meio dos resultados das histórias de usuário concluídas não é uma configuração única. É uma disciplina contínua que exige vigilância e adaptação. Ao mudar o foco de saída para resultado, as equipes podem garantir que seu trabalho realmente importe.

Lembre-se de que o objetivo não é a perfeição, mas o progresso. Cada história concluída oferece uma oportunidade de aprendizado. Use as métricas para orientar decisões, e não para julgar o desempenho. Quando a equipe se alinha em torno do valor, o trabalho torna-se mais significativo e os resultados mais impactantes.

Comece pequeno. Escolha uma história. Defina um resultado claro. Meça-o. Aprenda. Repita. Essa abordagem iterativa constrói uma estrutura sólida para o sucesso que escala com a organização.