Dans les environnements de développement modernes, la définition de la complétion a évolué. Terminer simplement une tâche ou écrire du code n’est plus synonyme de livraison de valeur. Les équipes s’éloignent de plus en plus du comptage des lignes de code ou du simple coché des cases sur un tableau de backlog pour se concentrer sur l’évaluation de l’impact réel de leur travail. Ce guide explore le changement fondamental du volume de production vers les résultats, en fournissant un cadre pour mesurer le succès à travers les résultats des histoires d’utilisateur achevées.

Le succès dans la livraison n’est pas un état binaire de terminé ou non terminé. C’est un spectre de réalisation de valeur. Lorsqu’une histoire est marquée comme achevée, la vraie question devient : Ce changement a-t-il amélioré l’expérience de l’utilisateur final ? A-t-il résolu le problème fondamental ? A-t-il fait bouger la needle du business ? Répondre à ces questions exige une approche réfléchie en matière de mesure, de validation et de retour d’information.

Comprendre les résultats des histoires d’utilisateur par rapport aux sorties 🔄

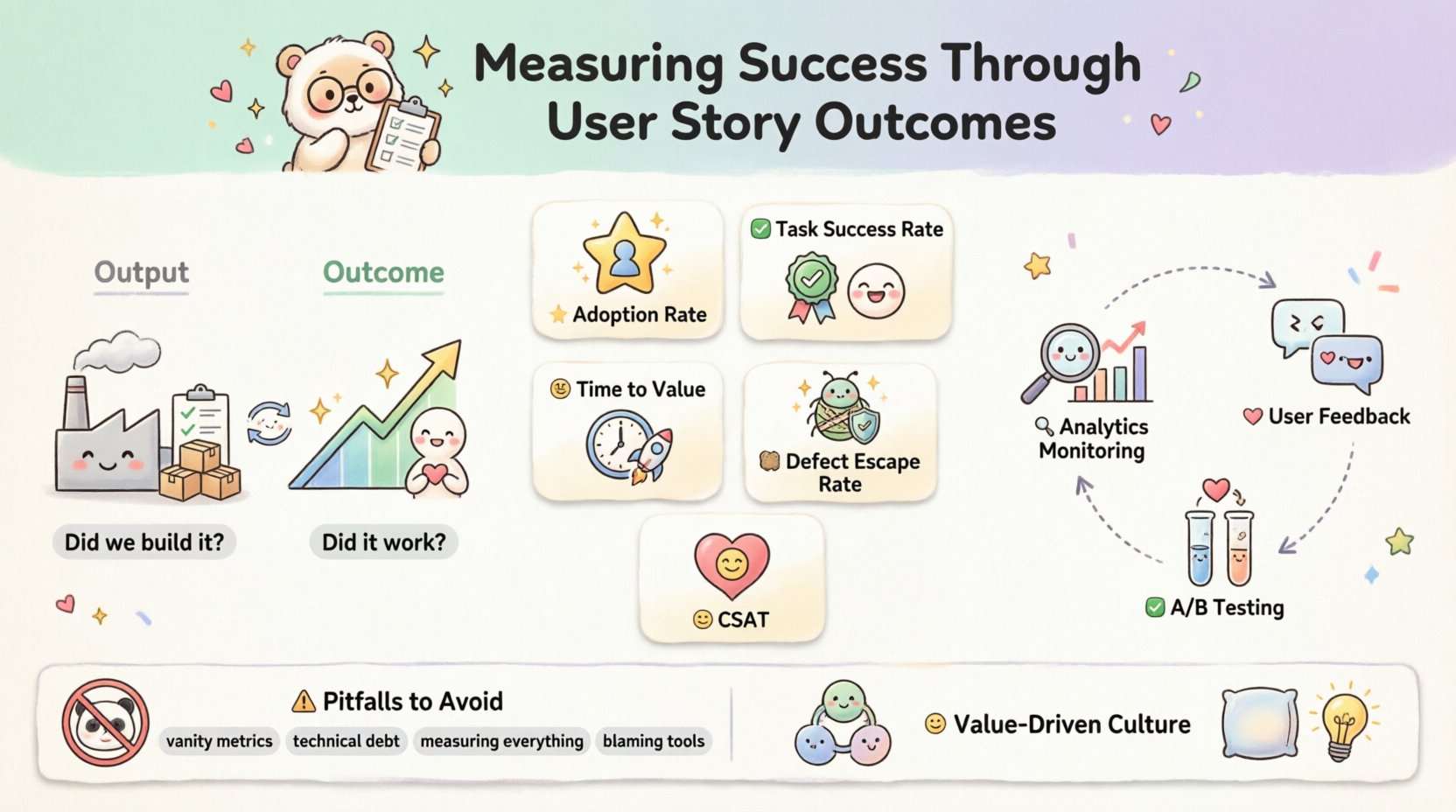

Pour mesurer le succès avec précision, il faut d’abord faire la distinction entre ce qui est produit et ce qui est accompli. Cette distinction forme la base d’un choix efficace des indicateurs.

- Sortie : Cela fait référence aux artefacts tangibles créés. Cela inclut le nombre d’histoires achevées, le nombre de fonctionnalités livrées, ou la vitesse de l’équipe. Cela répond à la question : « L’avons-nous construit ? »

- Résultat : Cela fait référence au changement de comportement ou à la valeur livrée au client. Cela inclut une augmentation de la fidélisation, une réduction des tickets d’assistance, ou une amélioration des taux de complétion des tâches. Cela répond à la question : « Est-ce que ça a fonctionné ? »

Se fier uniquement aux indicateurs de sortie peut entraîner le syndrome de la « usine à fonctionnalités », où les équipes sont occupées mais figées. Les indicateurs de résultat imposent une responsabilité sur le résultat, et non seulement sur l’effort fourni. Ce changement exige de la transparence et une volonté d’accepter qu’une histoire achevée n’ait pas atteint son objectif si les données de résultat ne reflètent pas le succès.

Indicateurs clés pour mesurer le succès 📈

Choisir les bons indicateurs est crucial. Trop d’indicateurs créent du bruit ; trop peu cachent les problèmes. Le tableau suivant décrit les indicateurs essentiels à suivre lors de l’évaluation des résultats des histoires d’utilisateur.

| Indicateur | Définition | Pourquoi cela importe |

|---|---|---|

| Taux d’adoption | Le pourcentage d’utilisateurs qui interagissent avec une nouvelle fonctionnalité après sa mise en ligne. | Indique si la solution est réellement utile pour le public cible. |

| Taux de réussite des tâches | Le pourcentage d’utilisateurs qui accomplissent une tâche spécifique sans aide. | Mesure l’utilisabilité et la clarté de la fonctionnalité mise en œuvre. |

| Temps de valeur | La durée entre la mise en ligne et l’obtention de bénéfice par l’utilisateur grâce à la fonctionnalité. | Met en évidence l’efficacité de la livraison et la pertinence de la solution. |

| Taux d’échappement des défauts | Le nombre de bogues signalés par les utilisateurs après que l’histoire a été marquée comme achevée. | Reflète la qualité du travail et l’efficacité des tests. |

| Score de satisfaction client (CSAT) | Retours directs des utilisateurs concernant leur expérience face au changement. | Fournit une validation qualitative du résultat. |

Lors de la mise en œuvre de ces indicateurs, assurez-vous qu’ils sont en accord avec l’intention spécifique de l’histoire utilisateur. Une histoire visant à optimiser les performances ne doit pas être mesurée par les taux d’adoption, tandis qu’une histoire visant à améliorer l’engagement des utilisateurs ne doit pas être mesurée uniquement par la stabilité du code.

Définir des critères d’acceptation clairs ✅

Les critères d’acceptation sont le contrat entre l’équipe et les parties prenantes. Ils définissent les conditions dans lesquelles une histoire utilisateur est considérée comme terminée. Toutefois, pour la mesure des résultats, ces critères doivent aller au-delà de la correction fonctionnelle.

- Exigences fonctionnelles : Le système doit se comporter d’une manière spécifique. (par exemple : « Le bouton doit soumettre le formulaire. »)

- Exigences non fonctionnelles : Le système doit respecter des normes de performance ou de sécurité. (par exemple : « La page se charge en moins de 2 secondes. »)

- Critères basés sur les résultats : Le système doit atteindre un résultat spécifique. (par exemple : « Les utilisateurs doivent pouvoir terminer le processus de paiement sans abandonner le panier. »)

Rédiger des critères basés sur les résultats exige une collaboration. Il ne suffit pas de dire que la fonctionnalité est construite ; l’équipe doit définir ce que signifie le succès dans le monde réel. Cela implique souvent la formulation d’une hypothèse. Par exemple : « Si nous mettons en place ce nouveau menu de navigation, les utilisateurs trouveront les produits 20 % plus rapidement. »

Pour valider cela, les critères d’acceptation doivent inclure un mécanisme de mesure. Cela pourrait être un événement d’analyse spécifique à suivre ou une question de sondage à déployer lors de l’accès à la fonctionnalité.

Validation post-mise en œuvre 🔍

Une fois qu’une histoire est fusionnée et déployée, le travail n’est pas terminé. La validation est le pont entre le développement et la réalisation de la valeur. Cette phase consiste à surveiller le système et à recueillir des données pour confirmer l’hypothèse.

1. Surveillance des analyses

Suivez les comportements définis dans vos critères d’acceptation. Si l’objectif était de réduire les clics, vérifiez le parcours des clics. Si l’objectif était d’augmenter la conversion, surveillez le funnel. Les données doivent être disponibles immédiatement après le déploiement pour détecter les régressions ou confirmer les gains.

2. Boucles de retour des utilisateurs

Les chiffres vous disent ce qui se passe ; les utilisateurs vous disent pourquoi. Engagez-vous avec les équipes d’assistance pour recueillir des données qualitatives. Recherchez des motifs dans les tickets liés à la nouvelle fonctionnalité. Les utilisateurs sont-ils confus ? Sont-ils enchantés ? Les retours directs sont souvent plus exploitables que les chiffres bruts.

3. Tests A/B

Lorsque vous êtes incertain quant à la meilleure approche, testez des variations. Déployer une fonctionnalité sur une petite partie des utilisateurs permet une mesure contrôlée. Comparez les indicateurs de résultat du groupe témoin à ceux du groupe traité. Cela isole l’impact du changement spécifique.

Péchés courants dans la mesure ⚠️

Même avec les meilleures intentions, les équipes s’embrouillent souvent lorsqu’elles tentent de mesurer le succès. Être conscient de ces pièges courants aide à préserver l’intégrité du processus.

- Indicateurs de vanité :Se concentrer sur des chiffres qui ont bonne allure mais qui ne sont pas corrélés à la valeur métier (par exemple : nombre total d’inscriptions sans analyse de rétention). Évitez les indicateurs qui peuvent être manipulés sans apporter de progrès réel.

- Ignorer la dette technique :Optimiser pour la vitesse conduit souvent à des problèmes de qualité. Si une histoire est terminée rapidement mais nécessite une maintenance constante, le résultat à long terme est négatif. Mesurez la stabilité du code comme faisant partie du succès de l’histoire.

- Mesurer tout :Suivre trop d’indicateurs dilue la concentration. Choisissez un ou deux indicateurs clés de résultat par histoire. Si un indicateur n’est pas exploitable, ne le mesurez pas.

- Blâmer l’outil :Un manque de succès n’est pas toujours un problème d’outil. Il s’agit souvent d’un problème de portée, de compréhension ou d’adéquation au marché. Évitez de supposer que la plateforme est la cause première de mauvais résultats.

Intégrer des boucles de retour 🔄

La mesure est inutile sans action. Les données recueillies à partir des histoires utilisateurs terminées doivent alimenter le processus de planification. Cela crée un cycle d’amélioration continue.

Analyse rétrospective :Lors des rétrospectives d’équipe, discutez des données relatives aux résultats, et non seulement du processus. La story a-t-elle atteint son objectif ? Si non, pourquoi ? L’objectif était-il irréaliste ? L’implémentation était-elle déficiente ?

Affinement du backlog :Utilisez les données relatives aux résultats pour prioriser les travaux futurs. Si une story similaire n’a pas livré de valeur par le passé, reconsidérez l’approche ou réduisez sa priorité. Si un schéma de succès émerge, investissez davantage dans ce domaine.

Communication avec les parties prenantes :Partagez les résultats relatifs aux résultats avec les dirigeants d’entreprise. La transparence renforce la confiance. Montrer qu’une fonctionnalité a été livrée mais n’a pas atteint les attentes démontre l’honnêteté et un engagement envers la valeur plutôt que la simple apparence.

Favoriser une culture axée sur la valeur 🤝

Les indicateurs et les processus sont des outils, mais la culture est le moteur. Une équipe craignant l’échec ne mesurera pas les résultats de manière honnête. Elle manipulera les données pour donner l’illusion de succès.

- Sécurité psychologique :Créez un environnement où avouer qu’une story n’a pas fonctionné est sans risque. Cela permet des analyses post-mortem honnêtes et des apprentissages.

- Propriété partagée :Tout le monde dans l’équipe, des développeurs aux designers en passant par les product owners, doit s’intéresser au résultat. Le développement ne consiste pas seulement à écrire du code ; c’est résoudre des problèmes.

- Apprentissage itératif :Traitez chaque story comme une expérience. Même si le résultat est négatif, l’équipe a appris quelque chose de précieux sur l’utilisateur ou le système.

Ce changement culturel prend du temps. Il nécessite un renforcement constant de la part de la direction. Lorsque l’accent reste mis sur la résolution des problèmes plutôt que sur le respect des délais, l’équipe s’oriente naturellement vers de meilleures pratiques de mesure.

Conclusion : Le parcours de la valeur 🚀

Mesurer le succès à travers les résultats des stories utilisateurs complétées n’est pas une configuration ponctuelle. C’est une discipline continue qui exige vigilance et adaptation. En déplaçant l’accent de la production vers les résultats, les équipes peuvent s’assurer que leur travail a vraiment de la valeur.

Souvenez-vous que l’objectif n’est pas la perfection, mais la progression. Chaque story achevée offre une opportunité d’apprendre. Utilisez les indicateurs pour guider les décisions, et non pour juger les performances. Lorsque l’équipe s’aligne autour de la valeur, le travail devient plus significatif, et les résultats plus impactants.

Commencez petit. Choisissez une seule story. Définissez un résultat clair. Mesurez-le. Apprenez. Répétez. Cette approche itérative construit un cadre solide pour le succès qui évolue avec l’organisation.